こんにちは。弁護士の浅見隆行です。

2026年2月に入ってから生成AIの活用について興味深い調査結果が立て続けに公表されました。

1つは、パーソル総合研究所が2月3日に公開した「生成AIとはたらき方に関する実態調査」、もう1つは、NTTモバイル社会研究所が2月6日に公開した「6割超がAI要約で検索完結」です。

今日はこれらの調査を踏まえた上で、生成AIのリスク対策についてです。法律論はまったくありません。

効率化したはずが残業が増えている現実

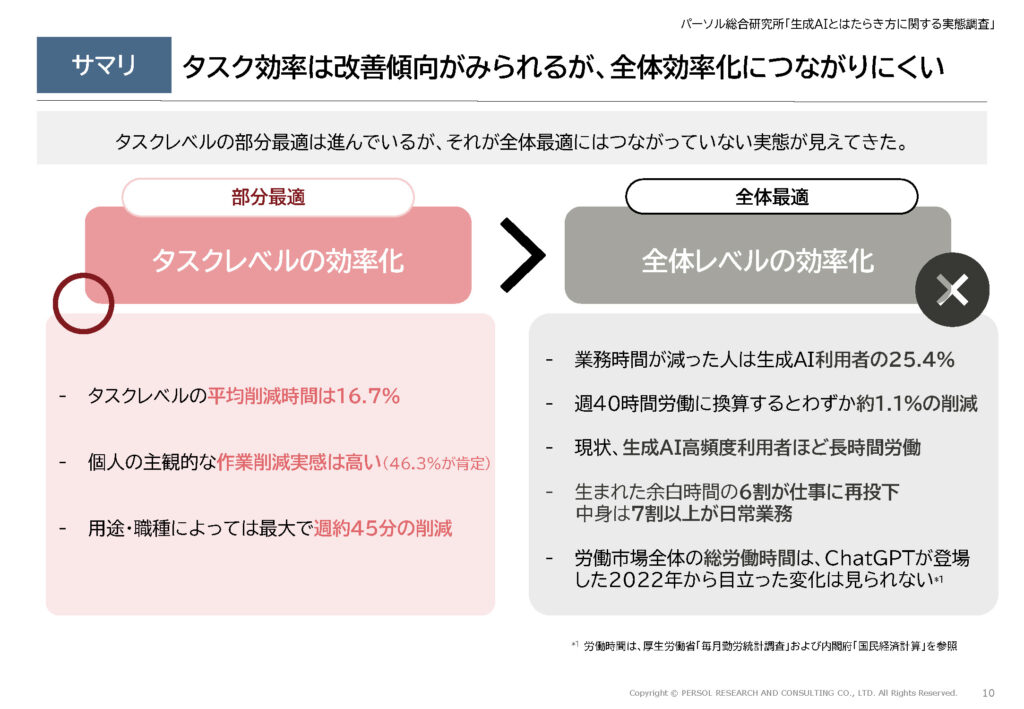

パーソル総研の実態調査によると、生成AIを業務で活用することで、タスク単位では週平均約26分(16.7%)の時間が削減されている、と報告されています。

一見すると業務の効率化が進んでいるように見えます。

しかし、その一方で、業務時間が減ったのは生成AI利用者の25.4%に留まり、生成AIの利用頻度が高いヘビーユーザーほど、実は残業時間が長いという逆転現象が起きています(下記写真は実態調査10ページからの引用)。

このようなことが起きる原因が2点指摘されています。

- 「いつもの仕事」に吸収される:AIで浮いた時間の約6割が、結局は別の日常業務に再投入されています。

- 普及・教育コストの集中:AIに詳しい特定の人(ヘビーユーザー)に、周囲への指導や学習の負担が偏っている。

1点目は業務の効率化の良い点だと思いますが、2点目は企業にとってリスクです。

生成AIのヘビーユーザーになり、生成AIの活用法について習熟すればするほど業務量が増える。

当人からしたら、それでいて労働条件、特に賃金や評価が従前のままなら、「こんな会社で、やってられない」という気持ちになるでしょうし、「もっと評価してくれる会社に転職しよう」と心も離れていくことは容易に想像できます。

実際に転職してしまえば、企業にとっても、ある日突然、生成AIに習熟した人が社内からいなくなり、業務の効率化には大きなダメージとなるはずです。

転職せずに社内に留まってくれていたとしても、業務の負荷が過大になったことで心身を患い、従前通りに働くことができなくなってしまった場合も同じようにダメージは生じるはずです。

企業は、生成AIのヘビーユーザーを複数育てて業務の偏りをなくし、かつ、ヘビーユーザーの業務量に見合った人事評価をしていかなければ、業務の持続性に支障を生じさせることにもなりかねません。

「答えだけ」を求め、想像力・思考力のない「従業員総白痴化」リスク

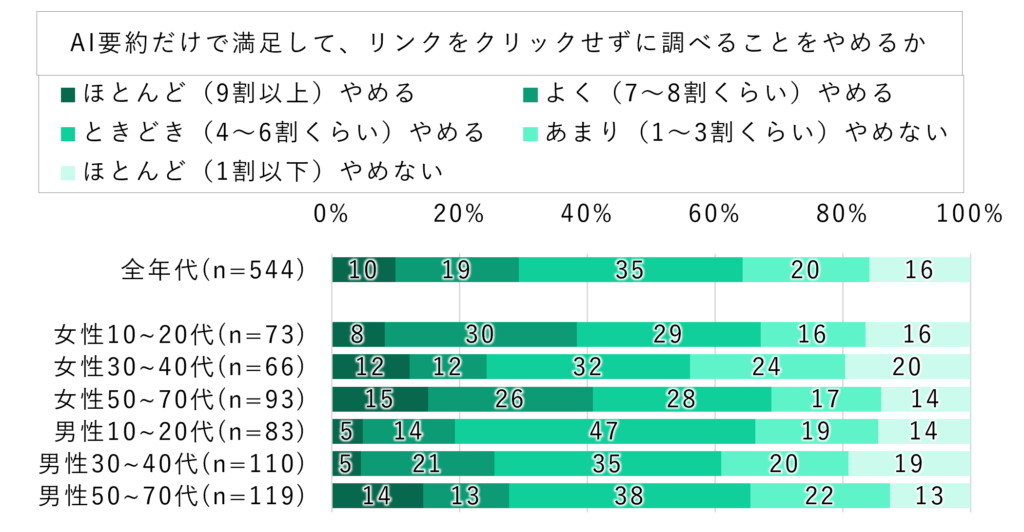

NTTのモバイル社会研究所の調査では、生成AI利用者の64%が、検索結果に表示されるAIの要約だけで満足し、元の情報源(リンク先)をクリックしない「ゼロクリック検索」の傾向にあることが分かりました(下記写真はモバイル社会研究所の調査から引用)。

NTTの調査結果で指摘されているのは、

- 「なぜそうなるか」という過程の理解より、単純な答えだけを知りたい

- 生成物の確認作業を人間ではなくAIに丸投げしてよいと考えている

という、マインドを持つ人ほどこの傾向が強いという点です。

人間がビジネスに向き合う意味は結論を求めることだけではなく、その結論に至るまでの思考プロセスにあるはずです。

結論に至るまでには、論理だけでなく周囲の人たちの感情・性格や置かれた立場、企業の力関係や企業・業界の風土・慣習・歴史など様々な要素を考慮し、あれこれと試行錯誤することで幅のある考え方ができるようになり、ビジネスパーソンとして成長します。

だからこそ、何も知らない、経験値の少ない新入社員よりも、経験値を詰んだ従業員が重宝されているのです。

しかし、そうした思考プロセスをスキップし、生成AIが提示する表面的な回答だけで満足し続けるようになると、想像力や深い思考力を奪うことになり、その結果、一億総白痴化ならぬ「従業員総白痴化」を招くリスクを孕んでいます。

既にSNSでは、考え方を質問していたりするポストに対して、生成AIに聞いた結果を貼り付けるだけという、自分の思考を放棄した使い方をしている残念な人たちを見ることができます。

数年経てば、社内の人材が想像力や思考力に欠け、生成AIの結果を鵜呑みにする人だらけになり、そうなれば、当然、企業としての成長性も失われるような気がします。

企業が講じるべきリスク対策

企業がこれのリスクを乗り越えるためには、今から手を打っておく必要があります。

もちろん、リスクがあるからといって生成AIを全面的に禁止することは、もはや非現実的でしょう。

生成AI人材の育成

対策の第1は、生成AIに熟練した特定の人に業務の負担が集中しないよう、生成AIを利用する際の効果的なプロンプトを社内で共有し、生成AIに熟練した従業員を複数確保する、もっと言えば従業員の誰でもが効果的に生成AIを利用できるまで成長させることです。

そうなれば、特定の人に負担が集中することを避けることができるでしょう。

生成AIの利用に長けた従業員が増えれば、それも対外的なアピールポイントになるはずです。

生成AI時代にあった人事評価制度の見直し

対策の第2は、適切な「問い」を立て、独自性・創造性の高い生成結果を導ける人を評価するように人事制度を見直すことです。

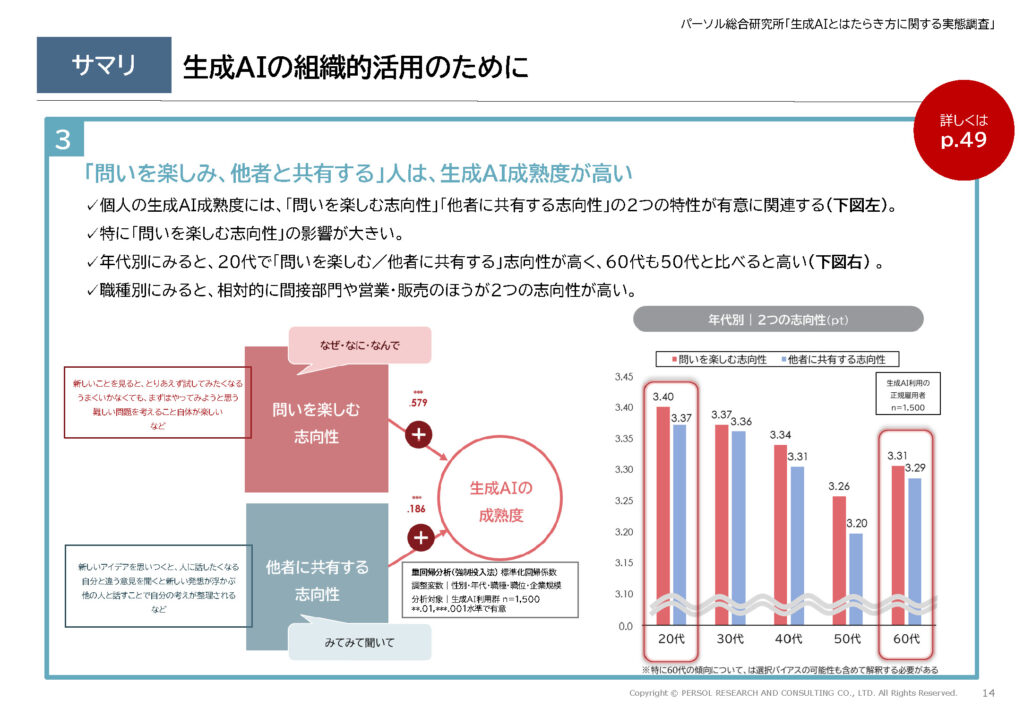

パーソル総研の実態調査では、AI成熟度が高い人は、「問いを楽しむ志向性」が強いことが分かっています(実態調査14ページ)。

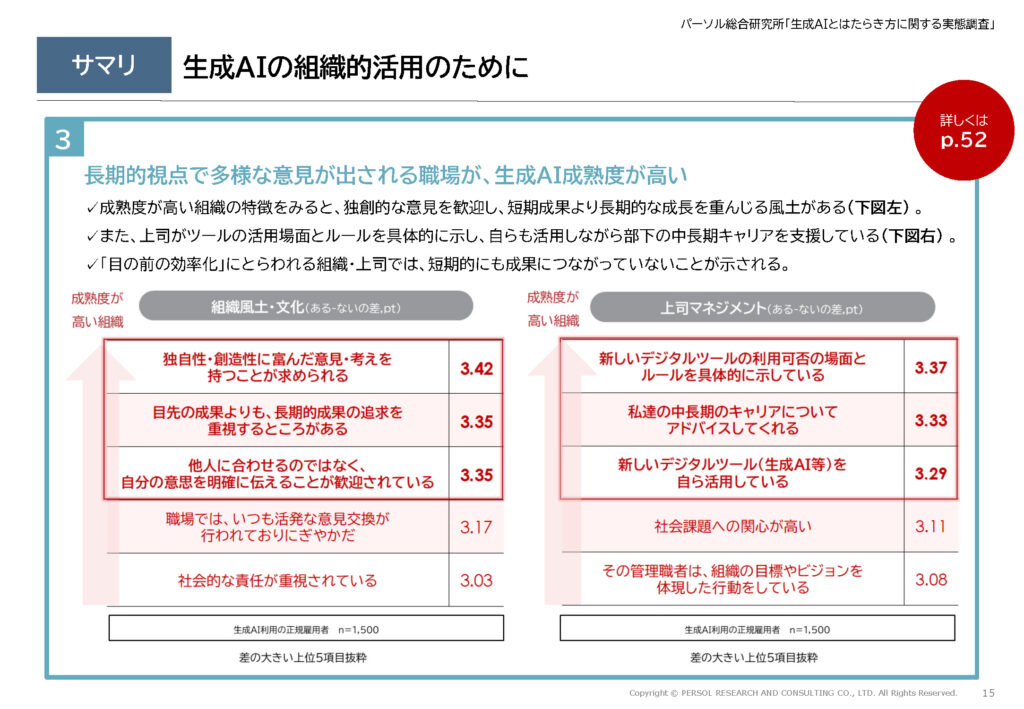

また、生成AIの利用に対する成熟度が高い会社は、「独自性・創造性に富んだ意見・考えを持つことが求められ」たり、「目先の成果よりも、長期的成果の追求を重視する」、「他人に合わせるのではなく、自分の意思を明確に伝えることが歓迎されている」などの傾向があります(実態調査15ページ)。

そのため、「適切な問いを立てる力」や「出力の根拠を検証する力」を持つことで、独自性・創造性に富んだ生成AIの結果を導ける人を評価するようになると、社内で生成AIの利用に熟練した従業員が確保しやすくなるような気がします。

他方、生成AIの結果だけをコピペするだけ人材を低い人事評価にするようになれば、そうした人材が生成AIの利用方法を見直すこともあるかもしれません。

そうなれば、生成された内容を検証し、さらに次の生成に繋げる・・・などの繰り返しになり、「従業員総白痴化」という自体も防げるのではないでしょうか。

これだけ企業の持続性について問われる時代になっているので、生成AIが持続性にどう影響するかも経営陣は考える必要があるように思います。